你是否好奇,為什麼NVIDIA的AI晶片能夠如此強大?背後的秘密武器,除了GPU本身,更離不開一種被稱為「記憶體全村希望」的關鍵技術。它就是HBM(高頻寬記憶體)。隨著AI運算需求呈爆炸性增長,傳統記憶體已逐漸成為效能瓶頸,而HBM的出現正是為了解決這個難題。本文將帶你從零開始,完整解析HBM是什麼、它與傳統記憶體的差異,以及它如何在AI時代扮演不可或缺的角色,並深入探討相關的AI晶片投資機遇。

本文核心要點

- HBM定義:一種基於3D堆疊技術的高效能DRAM,旨在解決數據傳輸瓶頸。

- 核心優勢:具備超高頻寬、低延遲、低功耗三大特性,是AI運算的理想選擇。

- 市場應用:廣泛應用於NVIDIA、AMD等高階AI晶片、GPU及高效能運算(HPC)領域。

- 產業格局:由SK海力士、三星、美光三大記憶體巨頭主導,並高度依賴台積電的CoWoS等先進封裝技術。

HBM (高頻寬記憶體) 到底是什麼?

要理解HBM,首先要明白AI運算的本質——處理海量數據。傳統的記憶體就像是單線道的鄉間小路,當數據車流量(運算需求)暴增時,就會造成嚴重塞車。而HBM的誕生,就是為了建造一條超寬的數據高速公路,徹底解決這個瓶頸。

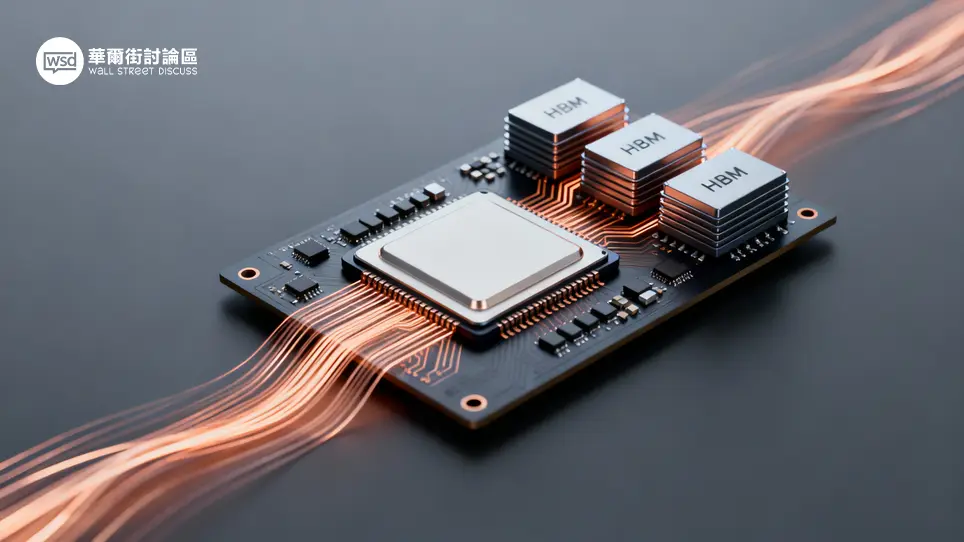

HBM 的基本定義:不只是記憶體,更是垂直堆疊的摩天大樓

HBM,全名為高頻寬記憶體(High Bandwidth Memory),是一種高規格的DRAM(動態隨機存取記憶體)。它與傳統DRAM最大的不同在於其創新的「3D堆疊」架構。想像一下,傳統的DDR記憶體晶片是在一塊2D的平面上並排排列,就像是平房。而HBM則是將多個DRAM晶片垂直堆疊起來,並透過稱為「矽穿孔」(TSV, Through-Silicon Via)的技術進行連接,形成一座記憶體摩天大樓。這種立體結構大幅縮短了數據傳輸的路徑,並增加了通道數量,從而實現了驚人的頻寬。

為何AI運算極度依賴「高頻寬」?從數據的超級高速公路談起

AI模型訓練,特別是深度學習,涉及數十億甚至數萬億個參數的並行計算。這就好比有成千上萬的工人(GPU運算核心)需要同時讀取和寫入數據(模型參數)。如果數據傳輸的道路(記憶體頻寬)不夠寬,工人就只能排隊等待,導致GPU的強大算力無法完全發揮,這就是所謂的「記憶體牆」(Memory Wall)問題。

HBM的超高頻寬,相當於為GPU打造了一條擁有數千條車道的超級高速公路,讓海量數據能夠瞬間在處理器和記憶體之間暢通無阻地流動,極大地提升了AI訓練和推論的效率。

HBM 的三大核心優勢:超高頻寬、低延遲、低功耗

- 🚀 超高頻寬 (High Bandwidth): 這是HBM最核心的優勢。透過1024位元甚至更寬的記憶體介面,HBM3E的頻寬已超過1.2 TB/s,是傳統高階GDDR6記憶體的數倍,能滿足AI晶片對數據吞吐量的極致要求。

- ⏱️ 低延遲 (Low Latency): 由於3D堆疊結構大幅縮短了晶片間的物理距離,數據傳輸的延遲顯著降低,這對於需要快速反應的即時AI應用至關重要。

- 🔋 低功耗 (Low Power Consumption): HBM在較低的運行時脈下即可實現高頻寬,且數據傳輸路徑更短,能量損耗更少。與GDDR相比,HBM在提供同等頻寬下的功耗可以降低約50%,這對於需要部署大量AI加速器且對能耗極其敏感的數據中心而言,是一大福音。

HBM vs. 傳統記憶體 (DDR/GDDR):一場決定AI效能的對決

為了更清晰地展示HBM的革命性,我們可以將它與大家更為熟悉的DDR(主要用於PC和伺服器)和GDDR(主要用於顯示卡)進行直接比較。這場對決的勝負,直接影響了未來AI晶片的效能上限。

| 特性 | HBM (高頻寬記憶體) | DDR / GDDR (傳統記憶體) |

|---|---|---|

| 架構差異 | 🏢 3D垂直堆疊:將多個DRAM晶片堆疊成一座高樓,內部以TSV技術高速互連。 | 🏠 2D平面排列:將DRAM晶片平鋪在PCB電路板上。 |

| 速度與頻寬 | 🏎️ 超高:採用超寬的記憶體介面(如1024-bit),時脈雖低但總頻寬極高(可達TB/s等級)。 | 🚗 較高:採用較窄的介面(如GDDR6為32-bit),依賴拉高運行時脈來提升速度。 |

| 功耗與體積 | 💡 低功耗、小體積:工作電壓低,傳輸路徑短,能效比高。與GPU整合封裝,佔用面積小。 | 🔌 高功耗、大體積:為追求高速而犧牲功耗,晶片需分散佈置在GPU周圍,佔用PCB面積大。 |

| 主要應用 | 高階AI加速器、GPU、超級電腦、網路交換晶片。 | 個人電腦、伺服器、主流遊戲顯示卡、遊戲主機。 |

AI時代的推手:拆解HBM在GPU與高效能運算中的應用

HBM並非一項遙不可及的技術,它已經成為當今最頂尖科技產品的核心元件,是驅動AI革命的關鍵引擎。

NVIDIA GPU的心臟:HBM如何為AI模型訓練提速

從NVIDIA的A100、H100到最新的Blackwell架構B200,HBM都是其不可或缺的標準配備。在訓練一個大型語言模型(LLM)時,GPU需要反覆讀取整個模型的龐大參數,並進行巨量矩陣運算。HBM的超高頻寬確保了這些數據能夠即時供應給數千個運算核心,使其算力得以完全釋放,從而將模型訓練時間從數月縮短至數週甚至數天。

AMD與其他HPC領域:數據中心與超級電腦的關鍵元件

不僅是NVIDIA,其主要競爭對手AMD的Instinct系列AI加速器同樣重度依賴HBM。此外,在科學計算、氣象預測、基因定序等高效能運算(HPC)領域,處理的數據集同樣龐大且複雜,HBM也成為了新一代超級電腦的關鍵元件,幫助科學家們解決過去無法應對的計算挑戰。

從HBM2、HBM3到未來的HBM4:技術演進之路

HBM技術本身也在飛速發展,每一代產品的效能都實現了巨大飛躍:

- HBM2/2E: 廣泛應用於上一代AI晶片,頻寬達到每堆疊460 GB/s。

- HBM3: 目前的主流,單顆堆疊頻寬提升至819 GB/s,被NVIDIA H100採用。

- HBM3E: HBM3的增強版,「E」代表Evolution,頻寬一舉突破1.2 TB/s,是NVIDIA B200等最新AI晶片的首選。

- HBM4: 預計在2026年後登場,將採用更寬的2048-bit介面,並可能整合部分邏輯運算功能,目標是將頻寬和能效提升到新的高度。

延伸閱讀

AI的快速發展不僅推動了記憶體的革新,更催生了龐大的投資機遇。想深入了解AI產業的未來趨勢與潛力股嗎?推薦閱讀:AI Agent股票投資新浪潮:AI代理是什麼?一篇看懂未來趨勢、應用與龍頭概念股。

HBM產業生態鏈:誰是這場技術革命的關鍵玩家?

HBM的製造涉及複雜的半導體技術,其產業鏈高度集中,主要由幾家寡頭壟斷。了解這些關鍵玩家,有助於我們把握HBM概念股的投資脈絡。

記憶體三巨頭:SK海力士、三星 (Samsung)、美光 (Micron) 的技術競賽

目前全球的HBM市場,幾乎由三大記憶體製造商瓜分:

- SK海力士 (SK Hynix): HBM技術的領跑者,最早與NVIDIA深度合作,在HBM3及HBM3E世代中佔據市場領先地位,市佔率一度超過50%。他們在技術和產能方面都具有先發優勢。更多關於其技術細節,可參考SK Hynix官方發布的HBM3E量產新聞。

- 三星 (Samsung): 作為全球最大的記憶體廠商,三星在HBM領域緊追不捨,憑藉其強大的研發實力和龐大產能,正積極爭取NVIDIA、AMD等大客戶的訂單,是市場上最強力的挑戰者。

- 美光 (Micron): 美光雖然起步稍晚,但也正奮力追趕,其HBM3E產品已開始出貨,並期望在下一代HBM4技術中取得突破,成為市場上不容忽視的第三股力量。

先進封裝的角色:台積電的 CoWoS 為何如此重要?

HBM無法像傳統記憶體一樣直接插在主機板上,它必須與GPU「緊密貼合」才能發揮效能。這就需要依賴先進封裝技術,其中最具代表性的就是台積電的CoWoS (Chip-on-Wafer-on-Substrate)。

CoWoS技術就像一個高科技的「托盤」,先將GPU晶片和多顆HBM堆疊晶片精準地放置在一塊矽中介層(Silicon Interposer)上,再將整個模組封裝到基板上。這個過程技術門檻極高,而台積電幾乎壟斷了全球CoWoS的產能。因此,即使記憶體廠商生產再多的HBM,如果沒有足夠的CoWoS產能配合,也無法最終製成AI晶片。這也使得台積電成為HBM產業鏈中無可替代的關鍵一環。深入了解CoWoS技術,可參閱CoWoS封裝還香嗎?臺積電的護城河有多深?

HBM概念股有哪些?投資前必知的產業趨勢

圍繞HBM的龐大商機,形成了一個完整的投資概念族群。除了上述核心企業,還包括:

- 記憶體製造商:SK海力士 (000660.KS)、三星電子 (005930.KS)、美光 (MU.US)。

- 先進封裝:台積電 (2330.TW / TSM.US)、日月光投控 (3711.TW)。

- 設備與材料供應商:應用材料 (AMAT.US)、ASML (ASML.US)、以及與TSV製程相關的設備商。

- 晶片設計與IP:NVIDIA (NVDA.US)、AMD (AMD.US)、以及提供記憶體介面IP的廠商如創意電子 (3443.TW)。

投資HBM概念股,等同於投資整個AI硬體的成長趨勢,但仍需注意產業週期性、技術迭代和市場競爭帶來的風險。

常見問題 (FAQ)

HBM會完全取代傳統的DDR記憶體嗎?

不會。HBM和DDR的定位不同。HBM追求極致的頻寬,但成本高昂且容量擴充彈性較低;而DDR記憶體則在成本、容量和靈活性上更具優勢。因此,在可見的未來,兩者將會共存。HBM專注於對頻寬要求極高的專業領域(如AI伺服器),而DDR將繼續主導個人電腦、一般伺服器等主流市場。

一般消費者的電腦或手機需要HBM嗎?

目前不需要。對於日常辦公、上網、影音娛樂和絕大多數遊戲而言,現有的DDR5和LPDDR5(用於手機的低功耗記憶體)已綽綽有餘。HBM的高昂成本和其所帶來的超高頻寬對於普通消費者來說,效能提升有限,不符合成本效益。未來,隨著端側AI(On-device AI)應用的普及,或許會出現針對消費級產品的簡化版高頻寬記憶體技術。

HBM技術未來最大的挑戰是什麼?

HBM未來面臨三大挑戰:成本、散熱和良率。首先,複雜的3D堆疊和CoWoS封裝工藝使得HBM的製造成本遠高於傳統記憶體。其次,將如此多的晶片高密度地堆疊在一起會產生巨大的熱量,如何有效散熱成為一大難題。最後,多層堆疊和精密的TSV鑽孔過程,任何一個環節出錯都可能導致整個昂貴的模組報廢,因此維持高良率是所有製造商持續努力的目標。

結論

總結來說,HBM(高頻寬記憶體)不僅僅是一項技術升級,更是推動整個AI和高效能運算領域前進的核心引擎。它的3D堆疊架構徹底打破了傳統記憶體的頻寬瓶頸,為未來更複雜、更龐大的AI模型鋪平了道路。從NVIDIA的GPU到數據中心的超級電腦,HBM已證明其無可取代的價值。

理解HBM是什麼,就是掌握了理解未來科技發展的關鍵鑰匙。對於關注AI、半導體產業的投資者而言,持續追蹤HBM技術的演進、主要玩家的競爭格局以及整個生態鏈的發展,無疑是洞察先機、把握未來趨勢的重中之重。

*本文內容僅代表作者個人觀點,僅供參考,不構成任何專業建議。